Günümüzün bilgi çağında, şirketlerin sahip olduğu veriyi etkili bir şekilde kullanabilmesi rekabet avantajı sağlamanın anahtarlarından biridir. Büyük dil modelleri (LLM’ler), bu veriyi anlamlandırma ve kullanma konusunda devrim yaratma potansiyeline sahip olsa da, sıklıkla güncel ve özel kurumsal verilere erişimde sınırlılıklar yaşarlar. İşte tam bu noktada Retrieval-Augmented Generation (RAG) devreye giriyor. RAG, LLM’lerin gücünü, kurumsal bilgi tabanınızdan elde edilen güncel bilgilerle birleştirerek, daha doğru, alakalı ve bağlamsal cevaplar üretmesini sağlar.

RAG Mimarisi Nasıl Çalışır?

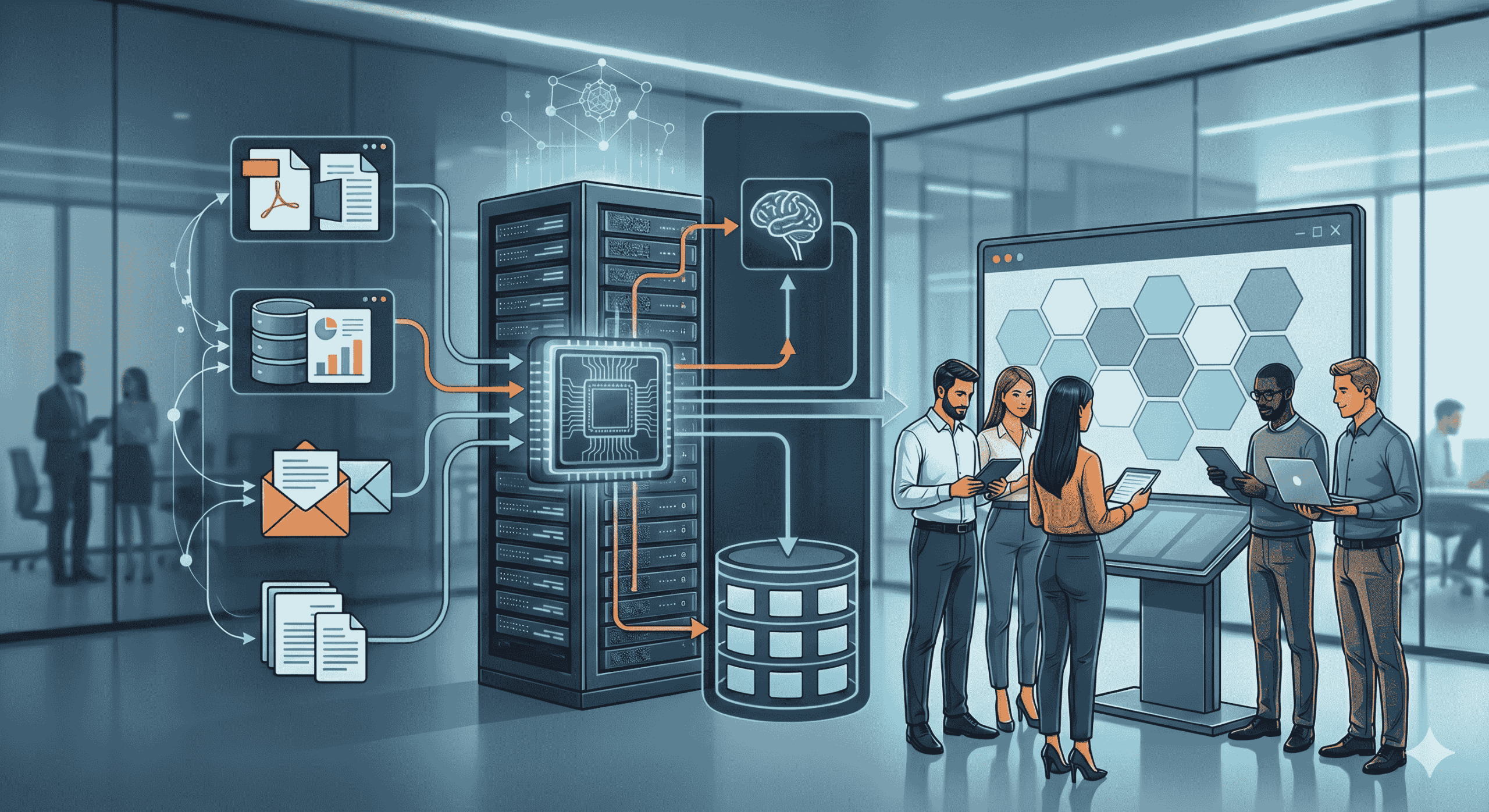

RAG mimarisi, temelde iki ana aşamadan oluşur: Retrieval (Erişim) ve Generation (Üretim). Erişim aşamasında, kullanıcı sorgusu alınır ve bir vektör veritabanında (örneğin, Pinecone, Chroma, Weaviate) benzerlik araması yapılarak, sorguyla en alakalı belgeler bulunur. Bu belgeler, genellikle önceden işlenmiş ve vektörlere dönüştürülmüş kurumsal bilgi tabanını temsil eder. Daha sonra, üretim aşamasında, LLM (örneğin, GPT-3, BERT) bu belgeler ve kullanıcı sorgusuyla birlikte beslenir. LLM, bu bilgileri kullanarak, kullanıcıya özgü ve bağlamsal bir cevap üretir. Bu sayede, LLM’in kendi bilgi birikiminin ötesine geçilerek, güncel ve özel kurumsal verilere dayalı cevaplar üretilmesi sağlanır.

Kurumsal Verilerle LLM Eğitimi vs RAG

LLM’leri kurumsal verilerle kullanmanın iki temel yolu vardır: LLM’i ince ayar (fine-tuning) yaparak eğitmek veya RAG mimarisini kullanmak. İnce ayar, LLM’in parametrelerini belirli bir veri kümesi üzerinde güncelleyerek, modelin o veri kümesine daha iyi uyum sağlamasını hedefler. Ancak, bu yöntem zaman alıcı, maliyetli ve sürekli güncellenen veriler için pratik olmayabilir. Ayrıca, LLM’in halihazırda sahip olduğu bilgileri “unutmasına” (catastrophic forgetting) neden olabilir.

RAG ise, daha hızlı, daha ekonomik ve daha esnektir. Verilerde bir değişiklik olduğunda, sadece vektör veritabanını güncellemek yeterlidir. LLM’in yeniden eğitilmesine gerek yoktur. Bu, özellikle sık sık güncellenen bilgi tabanlarına sahip şirketler için büyük bir avantajdır. Ayrıca, RAG, LLM’in cevabının kaynağını göstererek, şeffaflığı ve güvenilirliği artırır. Global IT gibi global şirketler de, büyük ve sürekli değişen veri setleriyle uğraşırken RAG mimarisinin esnekliğinden ve hızından faydalanmaktadır.

En İyi Vektör Veritabanları Karşılaştırması

RAG mimarisinin başarısı, kullanılan vektör veritabanının performansına büyük ölçüde bağlıdır. Vektör veritabanları, yüksek boyutlu vektörleri (genellikle metin veya görüntü verilerinin sayısal temsilleri) depolamak ve hızlı bir şekilde benzerlik araması yapmak için tasarlanmıştır. Piyasada birçok farklı vektör veritabanı bulunmaktadır.

* Pinecone: Ölçeklenebilirliği ve performansı ile öne çıkar. Özellikle büyük veri kümeleri için uygundur.

* Chroma: Açık kaynaklı ve kullanımı kolaydır. Özellikle prototip geliştirme ve küçük ölçekli projeler için idealdir.

* Weaviate: Semantik arama ve bilgi grafikleri oluşturma yetenekleri sunar. Karmaşık veri ilişkilerini modellemek için uygundur.

* Milvus: Yüksek performanslı ve dağıtık bir vektör veritabanıdır. Gerçek zamanlı uygulamalar için tasarlanmıştır.

Hangi vektör veritabanının en uygun olduğu, projenin özel gereksinimlerine bağlıdır. Veri kümesinin boyutu, sorgu hızı gereksinimleri, maliyet ve kullanım kolaylığı gibi faktörler dikkate alınmalıdır.

RAG Projelerinde Veri Segmentasyonu Teknikleri

Veri segmentasyonu, kurumsal bilgi tabanını daha küçük, daha anlamlı parçalara ayırma işlemidir. Bu, RAG sisteminin performansını ve doğruluğunu artırmaya yardımcı olur. Farklı veri segmentasyonu teknikleri mevcuttur:

* Cümle Segmentasyonu: Metni cümlelere ayırmak en basit yaklaşımlardan biridir.

* Paragraf Segmentasyonu: Metni paragraflara ayırmak, daha fazla bağlam sağlamaya yardımcı olabilir.

* Anlamsal Segmentasyon: Metni, anlamsal olarak ilişkili bölümlere ayırmak, daha karmaşık sorgular için daha iyi sonuçlar verebilir.

* Hiyerarşik Segmentasyon: Metni, farklı seviyelerde ayrıntıya sahip hiyerarşik segmentlere ayırmak, daha esnek bir arama deneyimi sunabilir.

Hangi veri segmentasyonu tekniğinin en uygun olduğu, veri kümesinin yapısına ve sorguların karmaşıklığına bağlıdır.

LangChain ile Kurumsal RAG Uygulaması Geliştirme

LangChain, LLM’lerle çalışmayı kolaylaştıran bir Python kütüphanesidir. RAG uygulamaları geliştirmek için güçlü araçlar ve modüller sunar. LangChain, farklı vektör veritabanları, LLM’ler ve veri segmentasyonu teknikleri ile kolayca entegre edilebilir. LangChain kullanarak, kurumsal bilgi tabanınızı RAG ile güçlendiren bir uygulama geliştirmek nispeten kolaydır.

Sıkça Sorulan Sorular

Neden ince ayar yerine RAG tercih edilmeli?

İnce ayar, bir LLM’in belirli bir veri kümesi üzerinde eğitilmesi işlemidir ve modelin o veri kümesine daha iyi uyum sağlamasını amaçlar. Ancak bu süreç, RAG’a kıyasla daha maliyetli ve zaman alıcıdır. Ayrıca, sık sık güncellenen kurumsal veriler için pratik bir çözüm değildir. RAG ise, daha esnek bir yaklaşımdır. Kurumsal bilgi tabanınız güncellendiğinde, sadece vektör veritabanını güncellemeniz yeterlidir; LLM’i yeniden eğitmenize gerek kalmaz. Bu, özellikle dinamik veri ortamlarında büyük bir avantaj sağlar.

RAG sistemlerinde veri güvenliği nasıl sağlanır?

RAG sistemlerinde veri güvenliğini sağlamak için çeşitli önlemler alınabilir. Öncelikle, hassas verilerin maskelenmesi veya anonimleştirilmesi önemlidir. İkincisi, vektör veritabanına erişimi kontrol etmek için sıkı erişim kontrol mekanizmaları uygulanmalıdır. Üçüncüsü, LLM’in hassas bilgileri ifşa etmesini önlemek için çıktı filtreleme teknikleri kullanılabilir. Dördüncüsü, veri aktarımlarını şifrelemek ve güvenli iletişim kanalları kullanmak önemlidir. Son olarak, düzenli güvenlik denetimleri ve güvenlik açığı taramaları yaparak, sistemdeki potansiyel zayıflıkları tespit etmek ve gidermek gereklidir.

Hangi vektör veritabanları Google Cloud ile en uyumludur?

Google Cloud, çeşitli vektör veritabanları ile uyumlu çalışır. Vertex AI Vector Search, Google Cloud’un kendi yönetilen vektör veritabanı hizmetidir ve LLM’lerle entegrasyonu kolaylaştırır. Ayrıca, Pinecone, Weaviate ve Milvus gibi popüler vektör veritabanları da Google Cloud üzerinde kolayca kurulabilir ve yönetilebilir. Hangi vektör veritabanının en uygun olduğu, projenin özel gereksinimlerine bağlıdır. Örneğin, çok büyük veri kümeleri için Vertex AI Vector Search veya Pinecone daha uygun olabilirken, daha küçük projeler için Weaviate veya Milvus yeterli olabilir.

Kurumsal Bilgi Tabanınızı RAG ile Güçlendirmek İçin Doğru İş Ortağı

RAG mimarisini kurmak; doğru vektör veritabanını seçmekten veri segmentasyonu stratejisine, LLM entegrasyonundan güvenlik katmanlarına kadar uzanan teknik bir süreçtir. Global IT, şirketinizin ihtiyaçlarına ve sektörüne özgü üretken yapay zeka stratejisi ve yol haritası oluşturarak, mevcut sistemlerinizle sorunsuz entegrasyon sağlayacak özelleştirilmiş Gen AI çözümleri tasarlamaktadır. Global IT Kurumsal bilgi tabanınızı akıllı bir sisteme dönüştürmek için Global IT uzmanlarıyla iletişime geçin. Global IT Generative AI Çözümlerini İnceleyin