Yapay Zeka Karar Mekanizmalarında Kurumsal Güven ve Stratejik Bütünlük Rehberi

Yönetim Özeti

Problem: Kurumlar, yapay zekayı hızla adapte ederken “algoritmik hesap verebilirlik” ve “etik itibar” riskleriyle karşı karşıya kalıyor. Kara kutu modeller, hukuki ve sosyal bir darboğaz yaratma potansiyeline sahip.

Çözüm (T-CAIM): Trust-Centric AI Integrity Model, YZ projelerini tasarım aşamasından canlı izleme aşamasına kadar 5 kritik katmanda denetleyen stratejik bir yönetim çerçevesidir.

Business Impact:

- Risk Azaltma: Hukuki yaptırım ve itibar kaybı risklerini tasarım aşamasında elimine eder.

- Güven Artışı: Şeffaflık ve açıklanabilirlik sayesinde müşteri ve yatırımcı güvenini perçinler.

- Sürdürülebilirlik: Regülasyonlara (EU AI Act vb.) tam uyum sağlayarak operasyonel sürekliliği garanti altına alır.

Giriş: Teknolojik Hızın Ötesinde Bir Yönetişim İhtiyacı

Yapay zeka (YZ), 2026 yılı itibarıyla kurumsal ekosistemlerin operasyonel katmanından çıkıp stratejik karar alma merkezlerine yerleşti. Ancak bu hızlı adaptasyon, beraberinde kritik bir soruyu getirdi: “Güvenmediğimiz bir zekanın kararlarından nasıl sorumlu olabiliriz?”

Teknoloji yönetiminde geride bıraktığım 25 yıl, bana en güçlü sistemlerin bile “insani ve etik bir pusula” olmaksızın kurumlar için birer itibar riskine dönüşebileceğini öğretti. T-CAIM (Trust-Centric AI Integrity Model), bu ihtiyaca bir yanıt olarak; YZ süreçlerini sadece teknik bir başarı kriteri olarak değil, kurumsal bir “bütünlük” (integrity) ve “güven” (trust) varlığı olarak yönetmek için tasarlanmıştır.

1. Katman: Stratejik Hazırlık (Strategic Readiness)

Yapay zeka yolculuğu, ilk kod satırıyla değil, ilk stratejik karar ile başlar. Bu katmanda hedef; YZ projelerini salt bir verimlilik aracı olmaktan çıkarıp, kurumun uzun vadeli varoluş amacıyla uyumlamaktır.

- Kurumsal Değerlerle Hizalanma: YZ’nin hangi alanlarda karar vereceği, kurumun etik anayasası ile çelişmemelidir.

- Çapraz Disiplinli Yönetişim: Sadece mühendislerin değil; hukuk, risk ve iş birimi liderlerinin masada olduğu bir “AI Etik ve Strateji Kurulu” oluşturulmalıdır.

- Veri Hijyeni ve Mimari Standartlar: Otonom kararların kalitesi, verinin kalitesiyle sınırlıdır. Veri yönetişimi (Data Governance), T-CAIM’in ilk operasyonel kalesidir.

2. Katman: Proaktif Etik Risk Analizi (Proactive Ethical Risk Assessment)

Hata payını sistem canlıya geçtikten sonra temizlemek, “itibar yangınını” söndürmeye çalışmaktır. T-CAIM, risk yönetimini tasarım aşamasına (Ethics by Design) çeker.

- Algoritmik Yanlılık (Bias) Denetimi: Eğitim setlerindeki tarihsel verilerin, toplumsal veya demografik önyargıları modellerimize bulaştırmadığından emin olmak teknik bir zorunluluktur.

- Etik Etki Analizi (EIA): Modelin çıktılarının müşteri segmentleri veya çalışan hakları üzerindeki olası negatif yansımaları, proaktif simülasyonlarla test edilmelidir.

- İnsan Denetimli Döngü (Human-in-the-Loop): Kritik kararların (kredi onayı, işe alım, tedarikçi seçimi vb.) tamamen otonom bırakılmadığı, stratejik onay mekanizmalarının kurgulandığı hibrit yapılar inşa edilmelidir.

3. Katman: Hukuki ve Mevzuat Uyumu (Legal amp; Regulatory Compliance)

Yapay zeka etiği vicdani bir tercih değil, 2026 dünyasında hukuki bir zorunluluktur. Bu katman, kurumu global regülasyonların karmaşasından koruyan bir kalkan görevi görür.

- Regülasyon Adaptasyonu: KVKK ve GDPR’ın ötesinde, EU AI Act gibi sertifikasyon gerektiren uluslararası standartlara “tasarım aşamasında uyum” (Compliance by Design) sağlanmalıdır.

- Sorumluluk Zinciri (Liability Chain): Otonom bir sistemin hatasından kim sorumludur? Yazılım sağlayıcı mı, veri sahibi mi, yoksa kurum mu? Bu belirsizlik, sözleşmesel ve hukuki protokollerle netleştirilmelidir.

- Fikri Mülkiyet ve Veri Egemenliği: Modellerin eğitiminde kullanılan verilerin telif hakları ve üretilen çıktıların mülkiyet sınırları yasal güvence altına alınmalıdır.

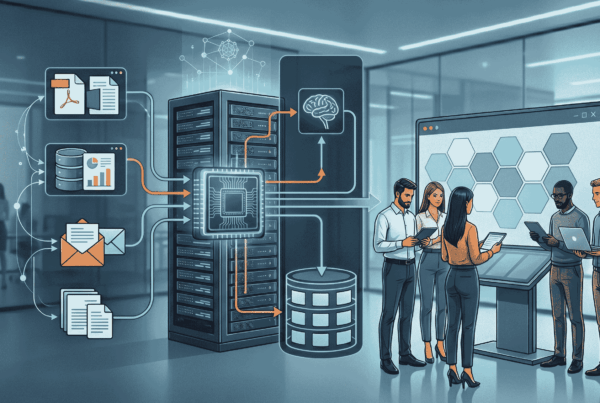

4. Katman: Dinamik Operasyonel İzleme (Dynamic Operational Monitoring)

Statik bir model, değişen dünyada hızla geçerliliğini yitirir. T-CAIM, modellerin performansını zaman içinde izleyen “canlı” bir denetim mekanizması öngörür.

- Etik Sapma (Ethical Drift) Takibi: Modeller sadece teknik başarı (hız/doğruluk) açısından değil, zamanla değişen veri setleri nedeniyle “etik değerlerden sapıp sapmadığı” açısından sürekli izlenmelidir.

- Algoritmik Devre Kesiciler (Fail-Safe): Beklenmedik bir çıktı veya regülasyon dışı bir hareket tespit edildiğinde, sistemin otomatik olarak “güvenli moda” geçmesini sağlayan teknik mimari kurulmalıdır.

- Bağımsız AI Auditing: Modellerin karar tutarlılığı, belirli periyotlarla bağımsız iç veya dış denetim süreçlerinden geçirilerek kayıt altına alınmalıdır.

5. Katman: Radikal Şeffaflık ve Açıklanabilirlik (Radical Transparency)

Güven, ancak anlaşılabilir olan şeyle kurulur. “Kara Kutu” (Black Box) modellerin devri, hesap verebilirlik duvarına çarpmıştır.

- Açıklanabilir YZ (Explainable AI – XAI): Karmaşık algoritmaların kararlarını, teknik olmayan bir yöneticinin veya müşterinin anlayabileceği “insan diline” tercüme eden ara katmanlar (Explainability Layers) devreye alınmalıdır.

- Hesap Verebilirlik Portalları: Denetleyici kurumlar veya hak sahipleri için, bir kararın hangi parametrelerle ve hangi veri dayanağıyla alındığını izlenebilir kılan şeffaf raporlama mekanizmaları kurulmalıdır.

- Güven Markalaması (Trust Branding): Kurumun YZ bütünlüğü konusundaki standartlarını kamuoyuna açıklaması, sadece bir “uyum” meselesi değil, pazar payını artıran bir “itibar yatırımı”dır.

Sonuç: Geleceği İnşa Etmek

T-CAIM, yapay zekayı bir “teknolojik eklenti” olarak değil, kurumun etik mirası ve stratejik geleceği olarak konumlandırır. 25 yıllık mühendislik ve yöneticilik disiplinimle gördüğüm en net gerçek şudur: Sadece hızla dijitalleşenler değil, bu dijitalleşmeyi “güven” üzerine inşa edenler 2030’lu yılların liderleri olacaktır.

Burak Akusta

Global IT International Executive Vice President